Des chercheurs de l’université américaine Johns Hopkins ont accompli une avancée majeure en robotique chirurgicale.

En effet, pour la première fois, un robot formé en regardant des vidéos de chirurgiens expérimentés a exécuté les mêmes procédures chirurgicales avec une habileté comparable à celle des médecins humains.

L’Apprentissage par imitation : vers des robots chirurgicaux autonomes

L’utilisation réussie de l’apprentissage par imitation pour entraîner des robots chirurgicaux élimine le besoin de programmer chaque mouvement spécifique requis lors d’une procédure médicale. Cela rapproche la robotique chirurgicale de l’autonomie totale, où les robots pourraient effectuer des interventions complexes sans assistance humaine.

Le modèle combine l’apprentissage par imitation avec la même architecture d’apprentissage automatique(Machine Learning) qui alimente ChatGPT. Toutefois, là où ChatGPT traite des mots et du texte, ce modèle « parle robot », en utilisant des concepts de cinématique. Il s’agit d’un langage mathématique qui décompose les angles de mouvement robotique.

Un modèle pour prédire les mouvements chirurgicaux

« C’est vraiment magique d’avoir ce modèle : il suffit de lui fournir des images de caméra, et il peut prédire les mouvements robotiques nécessaires pour la chirurgie ». C’est ce qu’a déclaré Axel Krieger, professeur adjoint au département de génie mécanique de l’université Johns Hopkins et auteur principal de l’étude.

Des tâches chirurgicales maîtrisées

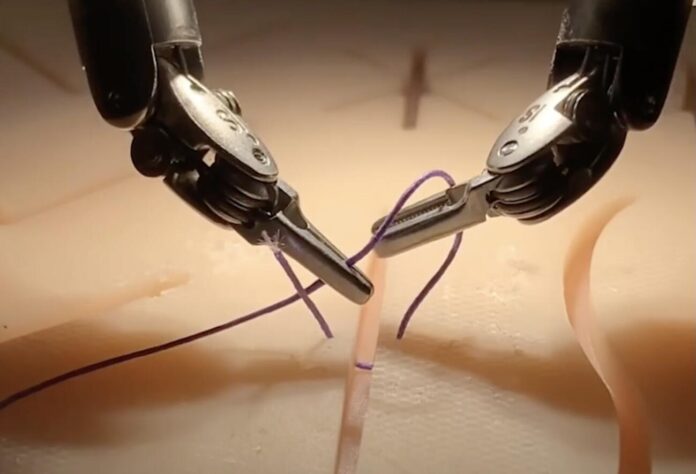

L’équipe, comprenant également des chercheurs de l’université Stanford, a utilisé l’apprentissage par imitation pour entraîner le robot Da Vinci Surgical System à réaliser trois tâches fondamentales dans les interventions chirurgicales :

Manipuler une aiguille, soulever des tissus corporels et réaliser des sutures.

Dans chaque cas, le robot, formé sur le modèle de l’équipe, a exécuté les procédures aussi habilement que des médecins humains.

En effet, les chercheurs ont alimenté leur modèle avec des centaines de vidéos enregistrées à partir de caméras placées sur les poignets des bras robotiques du système Da Vinci pendant des interventions chirurgicales. Ces vidéos, capturées par des chirurgiens du monde entier, sont utilisées pour des analyses post-opératoires avant d’être archivées. Actuellement, près de 7 000 robots Da Vinci sont utilisés à l’échelle mondiale, et plus de 50 000 chirurgiens sont formés sur ce système, générant une immense base de données que les robots peuvent « imiter ».

Bien que le système Da Vinci soit largement utilisé, les chercheurs soulignent qu’il est notoirement imprécis. Cependant, l’équipe a trouvé un moyen de rendre ces données imparfaites exploitables. La clé résidait dans l’entraînement du modèle à effectuer des mouvements relatifs plutôt que des actions absolues, souvent sources d’erreurs.

« Tout ce dont nous avons besoin, ce sont des images, et ce système d’IA trouve alors la bonne action », explique Ji Woong « Brian » Kim, auteur principal de l’étude et chercheur postdoctoral à Johns Hopkins.

« Nous constatons qu’avec seulement quelques centaines de démonstrations, le modèle est capable d’apprendre la procédure et de s’adapter à de nouveaux environnements qu’il n’a jamais rencontrés. »

The point of view of your article has taught me a lot, and I already know how to improve the paper on gate.oi, thank you.

**mind vault**

mind vault is a premium cognitive support formula created for adults 45+. It’s thoughtfully designed to help maintain clear thinking

Been playing 33vin for a while now and I’m pretty impressed with the variety of games they offer. There’s always something new to try! Site is secure, too, which is a big plus in my book. Check it out: 33vin

Looking for 999rgamedownload? It’s a breeze to grab this thing. Trust me, no headaches here. Check it out, dude: 999rgamedownload

Yo, phpopularcasino is alright! Got a decent selection of games and the site’s pretty easy to navigate. Feels like a good place to chill and try your luck. Check it out at phpopularcasino

Thanks for sharing. I read many of your blog posts, cool, your blog is very good. https://accounts.binance.info/de-CH/register-person?ref=W0BCQMF1